宽依赖窄依赖总结

宽依赖与窄依赖

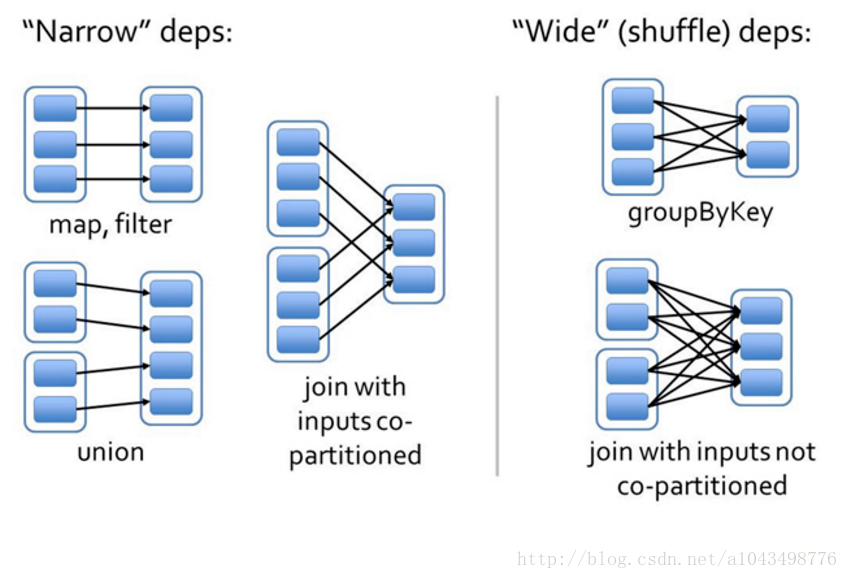

窄依赖(narrow dependency)和宽依赖(wide dependency, 也称 shuffle dependency).

-

窄依赖是指父RDD的每个分区只被子RDD的一个分区所使用, 子RDD分区通常对应常数个父RDD分区(O(1),与数据规模无关), map/filter和union

-

相应的,宽依赖是指父RDD的每个分区都可能被多个子RDD分区所使用, 子RDD分区通常对应所有的父RDD分区(O(n),与数据规模有关), join

宽依赖和窄依赖如下图所示:

相比于宽依赖,窄依赖对优化很有利 ,主要基于以下两点:

-

宽依赖往往对应着shuffle操作,需要在运行过程中将同一个父RDD的分区传入到不同的子RDD分区中,中间可能涉及多个节点之间的数据传输;而窄依赖的每个父RDD的分区只会传入到一个子RDD分区中,通常可以在一个节点内完成转换。

-

当RDD分区丢失时(某个节点故障),spark会对数据进行重算。

-

对于窄依赖,由于父RDD的一个分区只对应一个子RDD分区,这样只需要重算和子RDD分区对应的父RDD分区即可,所以这个重算对数据的利用率是100%的;

-

对于宽依赖,重算的父RDD分区对应多个子RDD分区,这样实际上父RDD 中只有一部分的数据是被用于恢复这个丢失的子RDD分区的,另一部分对应子RDD的其它未丢失分区,这就造成了多余的计算;更一般的,宽依赖中子RDD分区通常来自多个父RDD分区,极端情况下,所有的父RDD分区都要进行重新计算。

-

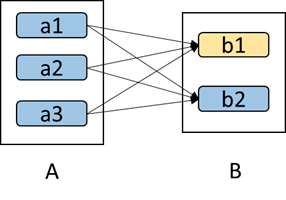

如下图所示,b1分区丢失,则需要重新计算a1,a2和a3,这就产生了冗余计算(a1,a2,a3中对应b2的数据)。

-

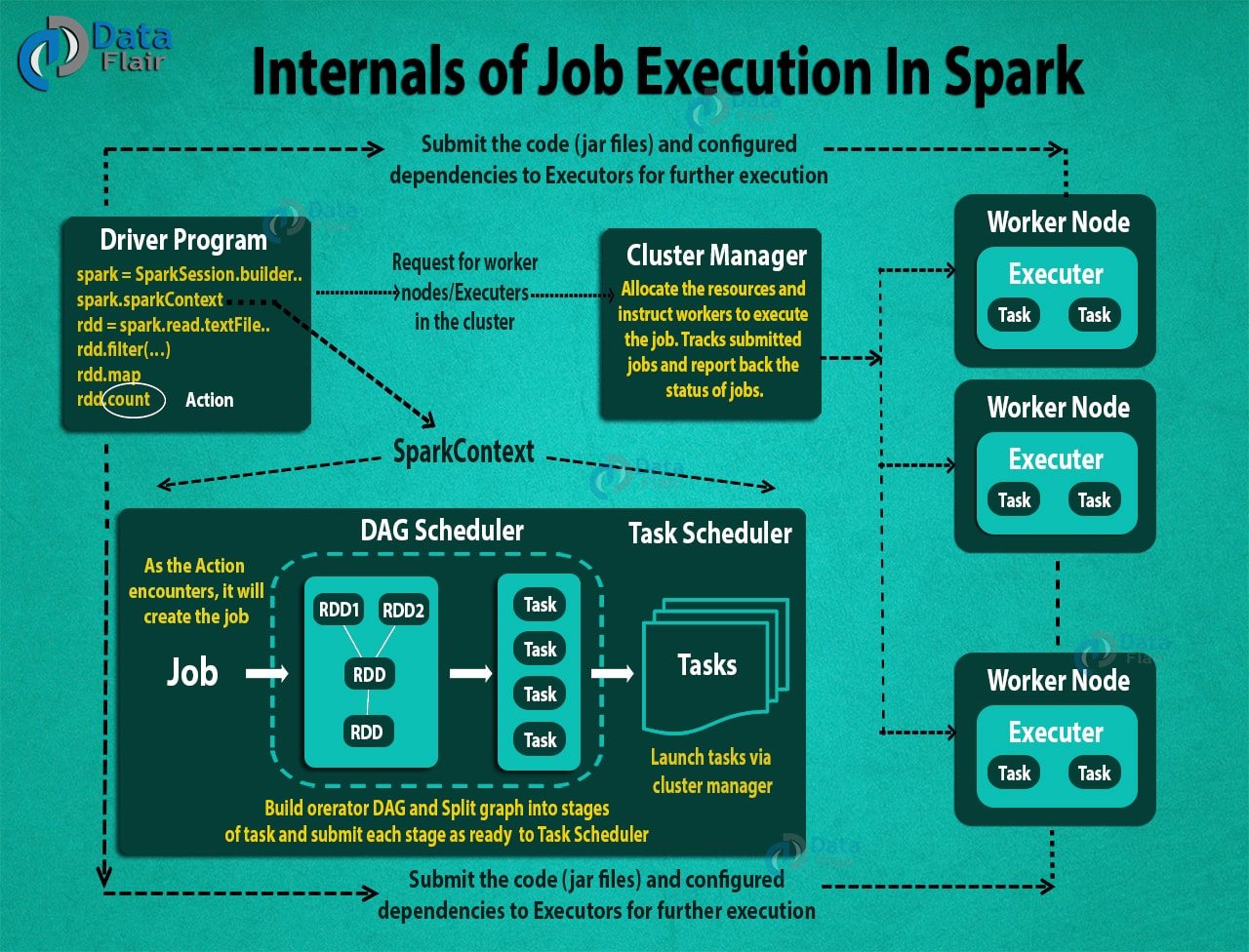

Job & Stage & Executor & Task

-

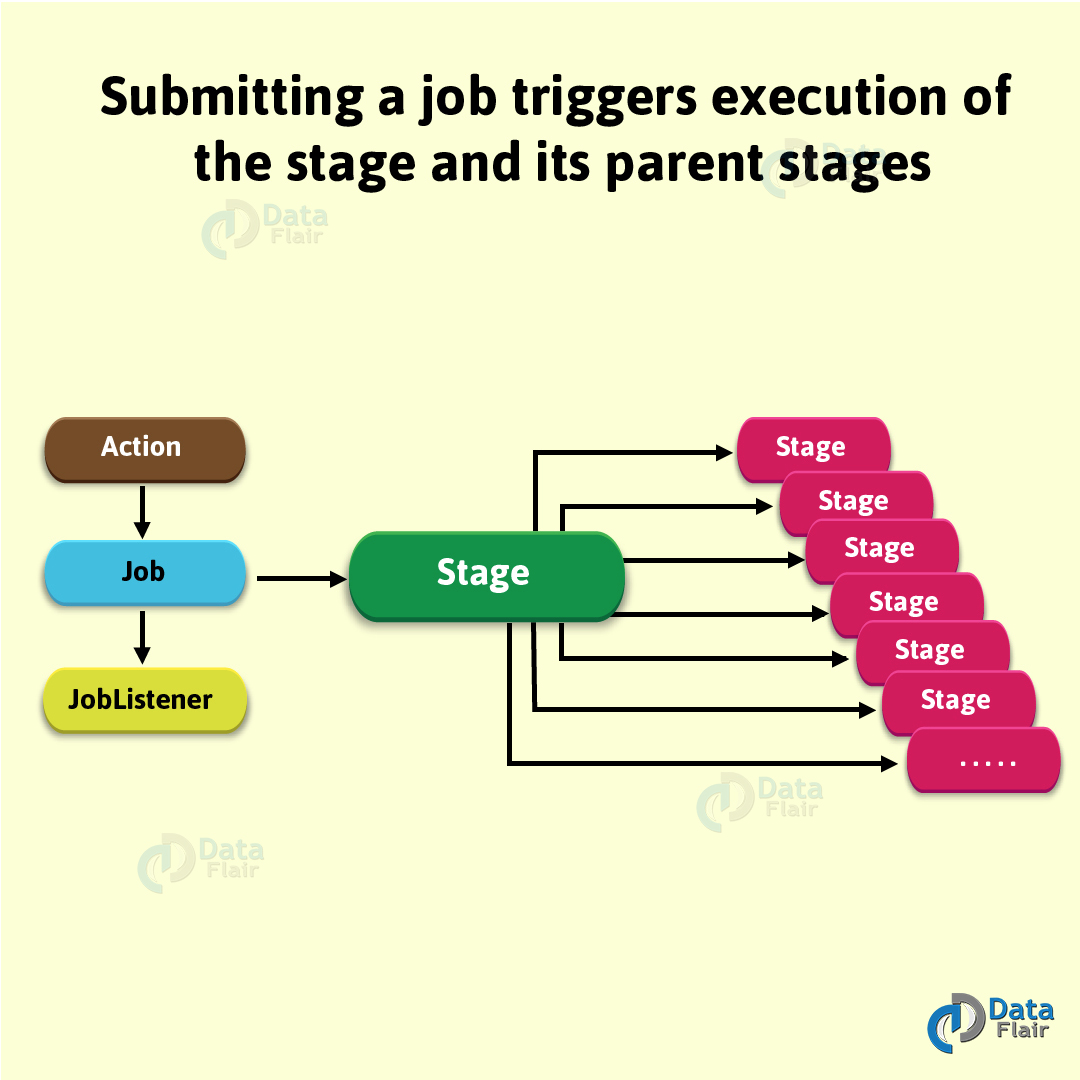

Job: A job is triggered by an action, like count() or saveAsTextFile(). 由action 触发

-

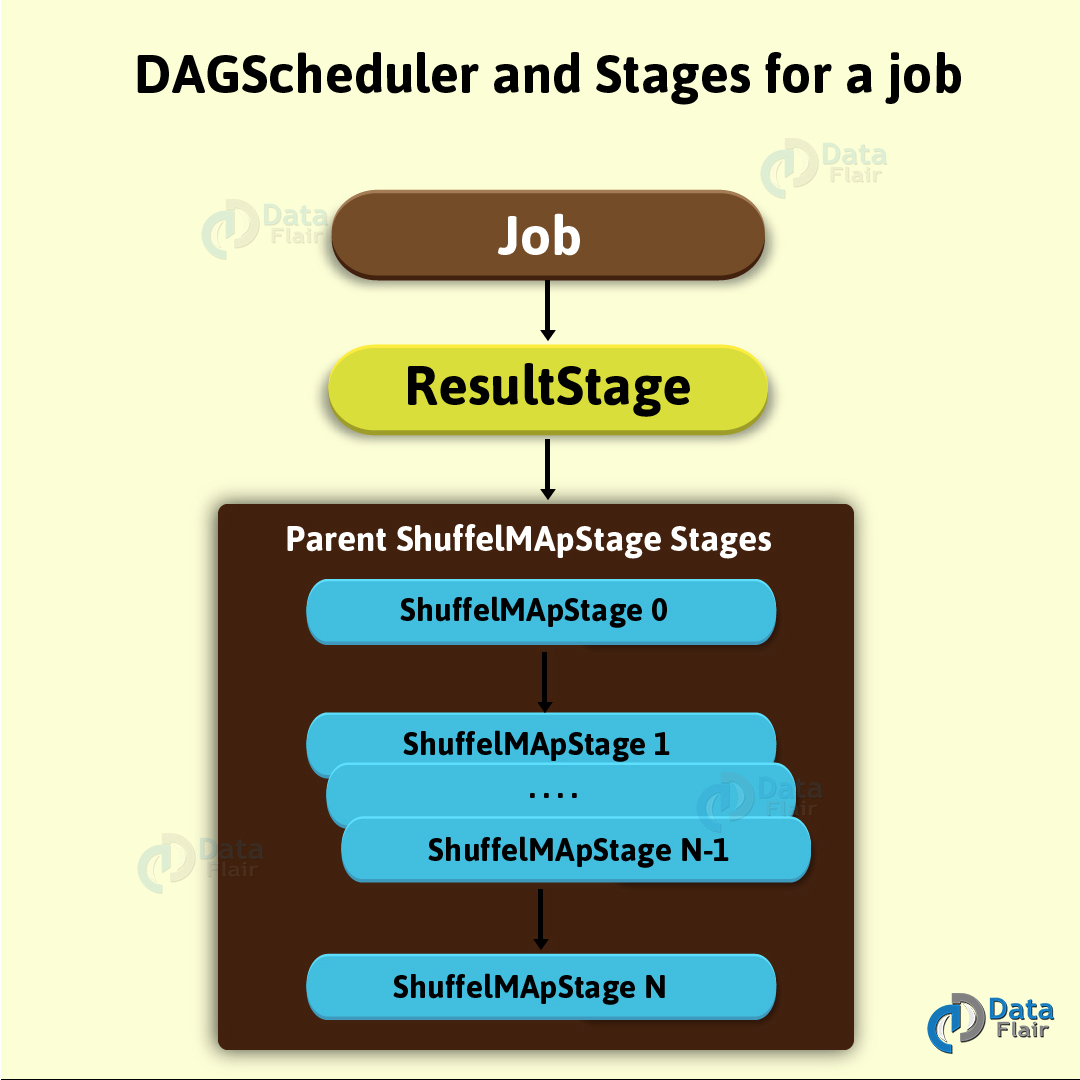

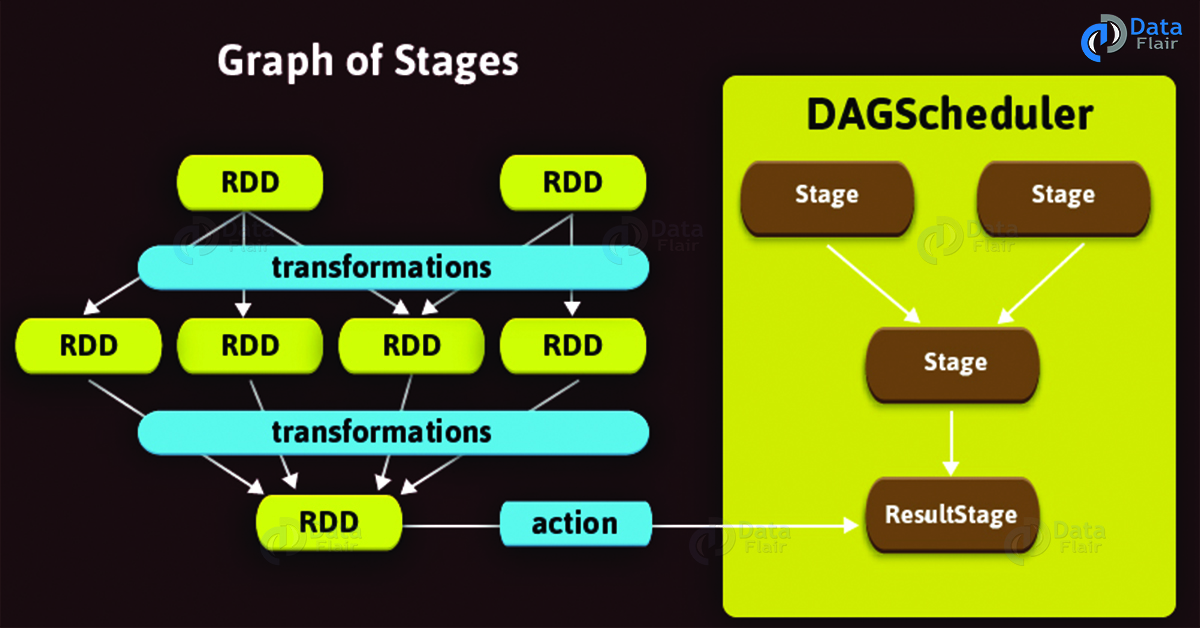

stage: 一个job会被拆分为多组Task,每组任务被称为一个Stage, Stage包含两类:

-

ShuffleMapStage in Spark

ShuffleMapStage 是在DAG中 属于中间层的stage, 会产生map output file的write disk操作,提供给下一个stage的task使用,并且增加了网络IO,跨stage会是一种高昂的开销,很多情况下应尽量避免, 另外 ShuffleMapStage可以被多个job共享!

-

ResultStage in Spark

-

action操作会包含在ResultStage里,是DAG中最终的stage, 里面的task会计算最终的action结果

stage内只会存在窄依赖, stage间存在宽依赖,一定存在shuffle过程!

- 在Spark中有两类task:

-

一类是shuffleMapTask

-

一类是resultTask

第一类task的输出是shuffle所需数据,第二类task的输出是result,stage的划分也以此为依据,shuffle之前的所有变换是一个stage,shuffle之后的操作是另一个stage。比如

-

rdd.parallize(1 to 10).foreach(println)

这个操作没有shuffle,直接就输出了,那么只有它的task是resultTask,stage也只有一个;如果是

rdd.map(x => (x, 1)).reduceByKey(_ + _).foreach(println)

这个job因为有reduce,所以有一个shuffle过程,那么reduceByKey之前的是一个stage,执行shuffleMapTask,输出shuffle所需的数据,reduceByKey到最后是一个stage,直接就输�

- 原文作者:知识铺

- 原文链接:https://geek.zshipu.com/post/%E4%BA%92%E8%81%94%E7%BD%91/%E5%AE%BD%E4%BE%9D%E8%B5%96%E7%AA%84%E4%BE%9D%E8%B5%96%E6%80%BB%E7%BB%93/

- 版权声明:本作品采用知识共享署名-非商业性使用-禁止演绎 4.0 国际许可协议进行许可,非商业转载请注明出处(作者,原文链接),商业转载请联系作者获得授权。

- 免责声明:本页面内容均来源于站内编辑发布,部分信息来源互联网,并不意味着本站赞同其观点或者证实其内容的真实性,如涉及版权等问题,请立即联系客服进行更改或删除,保证您的合法权益。转载请注明来源,欢迎对文章中的引用来源进行考证,欢迎指出任何有错误或不够清晰的表达。也可以邮件至 sblig@126.com